L'ère de la désinformation numérique

Les progrès en intelligence artificielle ont conduit à une explosion de faux contenus : images, vidéos, textes et sons, désormais indiscernables de contenus originaux. Les hypertrucages, en particulier, ont montré qu’il était possible de tromper même des observateurs attentifs, avec des implications profondes pour la gestion de l’information dans nos démocraties.

Face à cet enjeu, la France a d’ailleurs mis sur pied en 2021 l’organisme Viginum pour lutter contre les ingérences étrangères dans le domaine du numérique. Grâce à son travail de veille stratégique, on découvre que les hypertrucages ne sont pas de simples canulars qui visent à dénigrer une personnalité ou détourner le sens d’une information. Il peut s’agir d’une arme utilisée par des États voyous afin de déstabiliser le jeu politique des pays démocratiques.

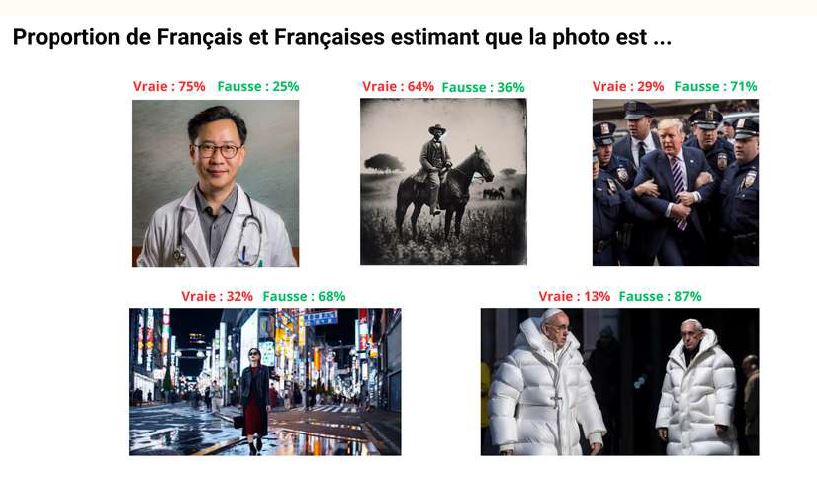

Un test de l’organisme de sondage l’IFOP sur un échantillon de 2000 Français démontre leur difficulté à discerner le vrai du faux. Sur 5 images montrées, toutes générées par l’IA, 75% ont cru à l’authenticité d’un portrait de médecin et 64% à celle d’une vieille photo d’homme à cheval. Une étude commanditée par Alucare.fr.

Les médias traditionnels sont souvent les premières victimes des pièges tendus par les deepfakes produits par des États ou groupes malveillants, tels que ceux soutenus ou financés par la Russie. En février dernier, par exemple, la chaîne de télévision publique France 24 en a fait les frais. Une vidéo détournant l’un de ses formats habituels a propagé une fausse nouvelle sur Emmanuel Macron, annonçant qu’il avait annulé sa visite en Ukraine « à la suite d’une provocation meurtrière à son encontre », autrement dit une potentielle tentative d’assassinat.

Comment distinguer le vrai du faux ?

Face au défi majeur de la désinformation impulsée par l’IA générative, on se sent souvent démunis et même désespérés. Et pourtant, les armes existent pour essayer au mieux de se protéger des fausses nouvelles et de développer l’esprit critique de toutes les générations, à commencer par les plus jeunes.

Voici trois stratégies clés à enseigner pour évaluer la véracité d’un contenu dans l’ère de l’IA :

- Cibler les erreurs types : On peut reconnaître des anomalies dans les productions de l’IA, telles que les déformations des mains, les incohérences de détails, les erreurs textuelles qui trahissent souvent une origine artificielle.

- Vérifier et contre-vérifier les sources : Il s’agit d’une pratique journalistique classique qui est malheureusement peu connue des personnes qui relaient des informations sur les réseaux sociaux sans toujours connaître leur origine. Chaque information doit être croiser avec d’autres sources afin de s’assurer non seulement qu’elle est vraie mais également que son contenu est complet et précis.

- Utiliser des services de vérification éprouvés : Alors que le monde anglophone a son FactCheck.org, Radio-Canada s’est doté de ses Décrypteurs, l’Agence Science-Presse de son Détecteur de rumeurs. C’est fort intéressant et utile d’y faire un tour régulièrement.

Finalement, on en revient toujours à la même conclusion : sans éducation critique aux médias et sans une formation continue au développement de l’esprit critique, la lutte contre la désinformation à l’ère de l’IA se fera avec des armes très inégales. La technologie ne cessera jamais de nous surprendre et de nous dépasser en matière de production de contenus. À nous de démontrer notre valeur et notre utilité pour nous assurer que ces contenus viennent véritablement nous informer et nous enrichir, au lieu de nous détromper et de nous influencer négativement.